近日,MCC实验室5篇论文被CVPR 2026 (IEEE/CVF Conference on Computer Vision and Pattern Recognition) 接收。

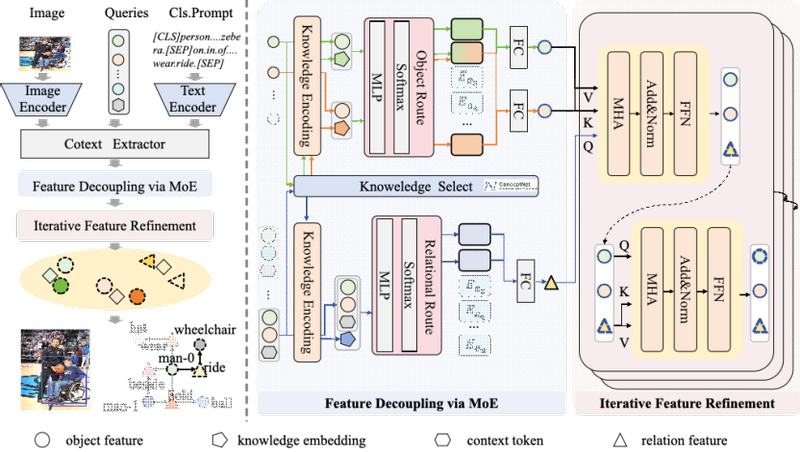

1. 论文题目:Mixture-of-Experts based Feature Decoupling for Open Vocabulary Scene Graph Generation

作者:李一鸣,游思思,鲍秉坤

通讯作者:鲍秉坤

论文概述:近年来,场景图生成(Scene Graph Generation, SGG)领域研究已取得显著进展,但主流方法仍受限于预定义的对象与关系类别,难以泛化至开放的真实世界场景。受开放词汇目标检测技术启发,近期已有研究尝试将SGG拓展到开放词汇领域,但这类模型通常依赖现成的视觉语言模型,既缺乏判别性的属性提取能力,也存在对象-关系语义交互不足的问题,最终导致新类别分类错误。针对上述问题,本文提出面向开放词汇场景图生成的混合专家特征解耦(MoE-FD)框架:该框架通过多专家网络自适应学习对象与关系的特征解耦,结合门控网络权重实现关键特征优先筛选;同时采用迭代交叉注意力机制建模对象与关系之间的语义交互,增强关系三元组关联能力与视觉-语义对齐效果。MoE-FD的主要贡献可归纳为三方面: 提出基于MoE的特征解耦框架,自适应增强对象与关系的判别性特征表征能力;构建对象与关系的语义交互建模机制,提升关系三元组关联效果与图文对齐精度;Visual Genome数据集上开展了大量实验,验证了MoE-FD方法的有效性。

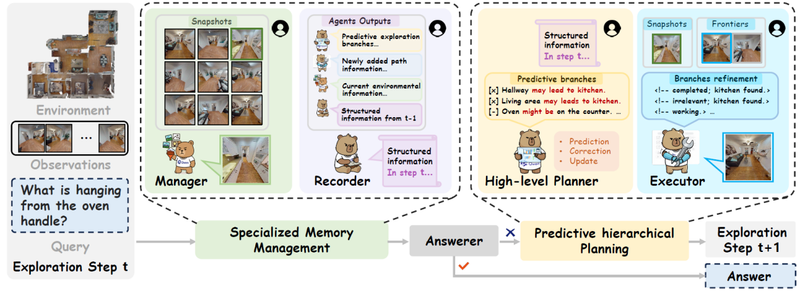

2. 论文题目:Predict Before You Explore: Predictive Planning with Specialized Memory for Embodied Question Answering

作者:袁博闻,游思思,鲍秉坤

通讯作者: 游思思

论文概述: 在具身问答任务中,智能体需要在部分可观测的动态3D环境中导航、收集视觉证据并进行推理。然而,当前基于视觉语言大模型(VLM)的智能体在维持连贯的长期行为时面临两大挑战:一是现有的规划方法多为反应式,导致跨步骤间行动不一致和轨迹不连贯;二是现有的智能体记忆方法将海量的无关轨迹与稀疏的关键线索混杂在一起,使得提取稀疏且关键的视觉证据极其困难。本文针对这些问题,从人类认知的预测处理视角出发,指出连贯的长期行为不应是对环境信息的被动反应,而是源自基于稳定先验的“预测-修正”循环。基于此,我们提出了一种名为Pred-EQA的新型架构,实现了从“被动探索”到“主动预测”的范式跃迁。该架构包含两个核心模块:1)预测式规划机制,由高层规划器“前瞻性”地预测关键证据的潜在位置,生成编码长期意图的探索分支;底层执行器则在分支内消除不确定性,并在预测出现偏差时进行动态闭环修正;2)双重记忆系统,将环境的探索轨迹先验与问题相关的核心视觉证据严格分离。这既为预测规划提供了稳定的全局视野,又确保了关键信息不再被冗余观测所淹没。在OpenEQA和Express-Bench基准数据集上的实验结果表明,Pred-EQA有效降低了探索冗余,在回答准确率和探索效率上均超过了当前最先进水平,充分验证了预测驱动机制在具身推理中的巨大潜力。

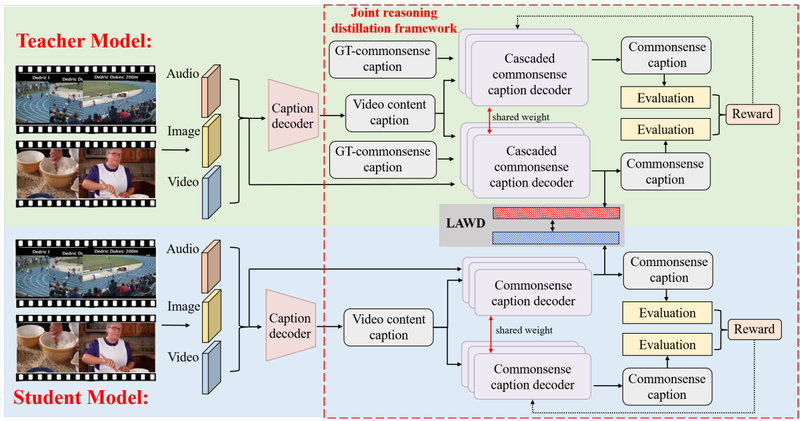

3. 论文题目:Self-Critical Distillation Network for Video-based Commonsense Captioning

作者:袁梦奇,贾耕云,鲍秉坤

通讯作者:鲍秉坤

论文概述:在视频常识描述生成任务中,模型不仅需要生成视频内容的描述,还需生成事件背后的多类常识描述。现有方法依赖“视频→内容描述→常识描述”的推理链,导致生成的常识缺乏视觉依据,且忽视了不同类别常识间的相关性。具体来说,首先该推理链使模型过度依赖内容描述,易生成笼统、视觉关联性有限的常识;其次,现有方法采用多个孤立解码器进行常识生成,未能利用不同类别常识间的关联。为解决上述问题,我们提出自批判蒸馏网络(SCD-Net),通过增强视觉推理与建立类别间常识关联优化推理链。具体而言,一方面引入自我批判学习并设计奖励函数,促使模型重新审视输出,激励其最大化利用视觉信息,提升视觉理解能力;另一方面提出联合推理蒸馏框架,结合级联解码器与知识蒸馏策略,促进不同常识类别间的相互推理与知识转移,同时保持测试公平性。在大规模Video-to-Commonsense数据集上的实验表明,我们的方法表现优异。

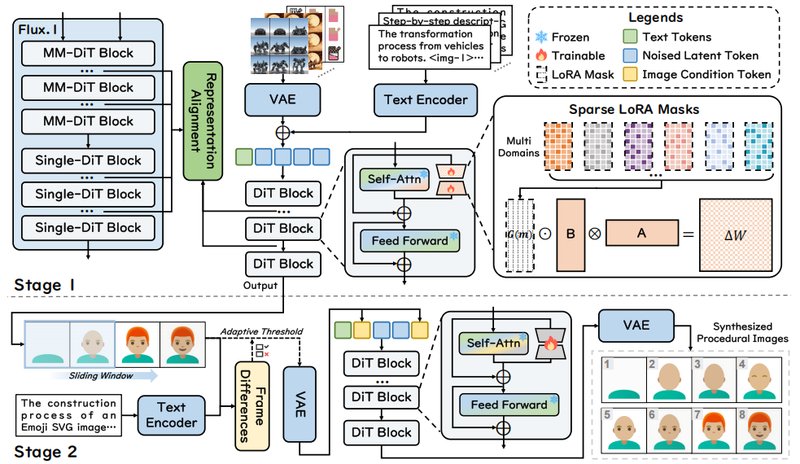

4. 论文题目:ProcessMaker: A Generalized Process Visualization Framework with Adaptive Sequence Steps on Diffusion Transformers

作者:徐梦玲,游思思,李亚宁,鲍秉坤

通讯作者:鲍秉坤

论文概述:在过程序列生成任务中,现有方法多聚焦单一领域或依赖多专家网络适配不同领域,存在对未见领域泛化能力差、参数冗余、生成步长无法根据过程复杂度自适应调整的核心问题。本文针对上述痛点,基于DiT架构提出通用过程可视化框架ProcessMaker,通过分析过程序列生成的领域特征与生成逻辑,设计了三个核心创新点:1)自监督表征对齐,挖掘预训练 DiTs 的固有泛化能力以适配未见领域;2)LoRA 稀疏掩码,在无需额外专家网络的前提下实现多领域建模,大幅降低参数规模;3)滑动窗口策略,通过计算帧间视觉与语义联合差异,结合自适应阈值动态调整生成步长。ProcessMaker 整体分为多领域泛化和自适应步长生成两个阶段,先通过稀疏掩码与表征对齐实现低参数成本的跨领域过程序列生成,再利用滑动窗口完成帧序列的动态优化。在21个不同领域的基准数据集上的实验结果表明,该方法仅使用现有最优方法7.3%的可训练参数,在文本图像对齐度、序列连贯性上均实现性能提升,同时能良好泛化至绘画、烹饪、工艺制作等各类领域,优于当前主流的通用扩散模型与领域专用过程生成模型。

项目地址:https://github.com/Molly260/ProcessMaker

5. 论文题目:SMRABooth: Subject and Motion Representation Alignment for Customized Video Generation

作者:许轩诚,李亚宁,游思思,鲍秉坤

通讯作者:游思思

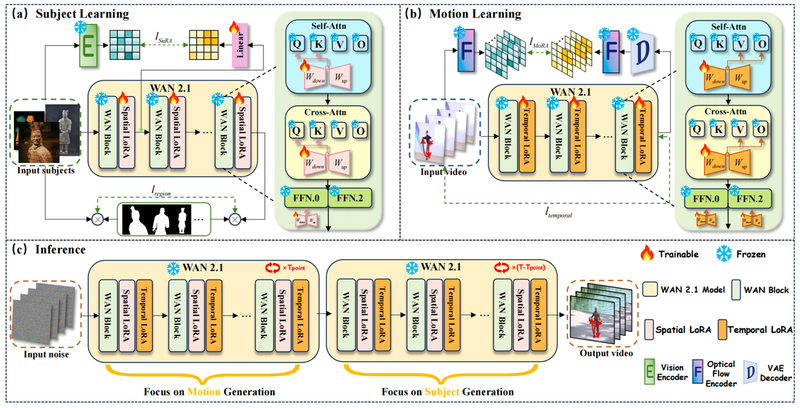

论文概述:定制视频生成旨在生成能够忠实保留参考图像中主体外观,同时保持参考视频中运动时间一致性的视频。现有方法因为缺乏主体和运动的物体级指导,所以难以确保主体外观相似性和运动模式一致性。为了解决这个问题,我们提出的 SMRABooth利用自监督编码器和光流编码器来提供物体级的主体外观和运动表示。这些表示在 LoRA 微调过程中与模型对齐。我们的方法分为三个核心阶段:(1)我们利用自监督编码器获取主体表示来指导主体对齐,使模型能够捕捉主体的整体结构并增强高层语义一致性。 (2) 我们利用光流编码器的运动表示来捕获结构一致且与外观无关的物体级运动轨迹。(3) 我们提出了一种主体-运动关联解耦策略,该策略在位置和时间上应用稀疏的LoRA注入,有效降低了主体和运动LoRA之间的干扰。大量实验表明,SMRABooth在主体和运动定制方面表现出色,能够保持一致的主体外观和运动模式,证明了其在可控文本到视频生成方面的有效性。

项目地址:https://github.com/xuxuancheng0208/SMRABooth

撰稿:李一鸣,袁博闻,袁梦奇,徐梦玲,许轩诚。审核:贾耕云

地址:江苏省南京市栖霞区仙林大学城文苑路9号(南京邮电大学仙林校区)计算机学科楼

电话:13813992640(贾老师)

邮箱:bingkunbao@njupt.edu.cn(鲍老师)